Le début de la fin

2022 a vu les différentes IA basées sur le Machine Learning s’ouvrir au grand public, et toute leur puissance est désormais accessible à n’importe quel curieux prenant le temps de s’y essayer. À bien des égards, cette nouvelle est aussi excitante qu’effrayante, mais le problème, parce qu’il y en a un, n’est peut-être pas aussi évident qu’on le croit. Retour d’expérience et considération sur la révolution en marche.

Le début du voyage

Vous en avez certainement entendu parler, vous en avez sûrement vu le résultat, mais vous n’avez peut-être pas encore mis les doigts dedans, mais pourtant les outils basés sur le Machine Learning (intelligence artificielle basée sur un apprentissage autonome, sans être explicitement programmée) sont partout et déjà massivement utilisés dans de nombreux domaines comme la finance, la santé (Watson), la robotique, l’information et la création graphique, domaine qui nous intéressera particulièrement aujourd’hui. Ce qui a changé cette année c’est que des mastodontes du game sont entrés en beta publique, voire en accès gratuit, permettant à tout un chacun de générer du texte (GPT) ou des illustrations (Dall-e, Stable Diffusion, Midjourney). On notera aussi qu’en parallèle, nombreuses solutions commerciales se sont déjà implantées et proposent les mêmes services mais avec un poil plus d’accompagnement et de contraintes, histoire d’obtenir plus facilement des résultats cohérents pour les novices n’ayant pas nécessairement le temps d’apprendre les différentes conventions (au lieu d’entrer des tags, vous aurez simplement à cliquer sur des options pré-définies)

Et ça fait flipper tout le monde, même Google qui commence à comprendre que l’IA est plus efficace pour chercher des trucs sur Internet qu’un humain avec Google.

En ce qui concerne la génération d’images, on ne va pas y aller par 4 chemins, Midjourney est clairement l’outil le plus extraordinaire de la douzaine d’outils que j’ai pu tester (la plupart étant dérivés d’OpenAi ou de Stable Diffusion, ceci expliquant cela), ou tout au moins, qui donne les résultats les plus impressionnants sans trop d’efforts dans leur version accessible au grand public, et je regrette amèrement d’avoir attendu aussi longtemps pour la tester (j’étais vraiment pas fan du principe de passer par Discord pour générer mes images en mode public)

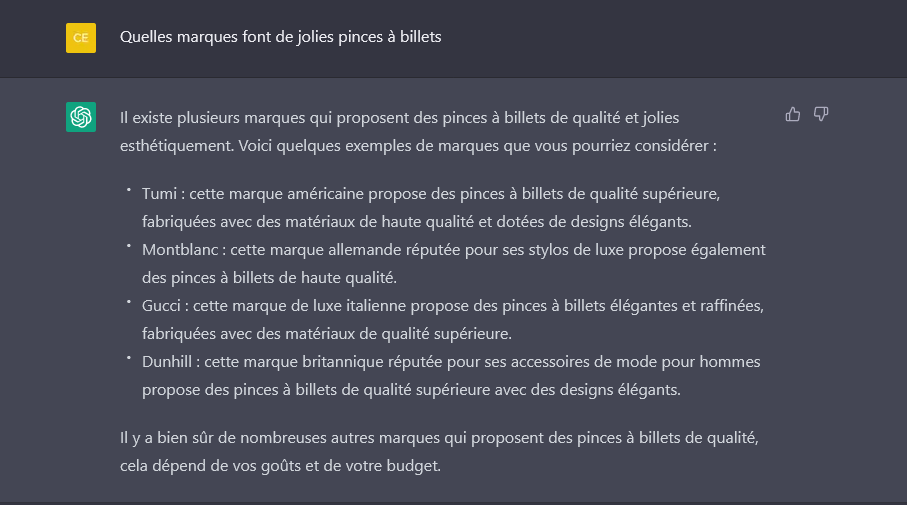

Dans l’exemple ci-dessus j’ai utilisé le mot-clé « by Katsuhiro Otomo » histoire d’orienter un peu le style, ça marche plus ou moins bien selon l’IA et selon l’auteur, mais généralement ça tombe pas très loin chez Midjourney. Et c’est le premier (faux ?) problème que cette technologique soulève.

Le mois dernier Ammaar Reshi sortait Alice and Sparkle, un livre illustré pour enfants… dont les illustrations on entièrement été générées par une IA en quelques jours. Très rapidement, des illustrateurs sont montés au créneau pour dénoncer un vol de propriété intellectuel, arguant que « ces créations utilisent leur style personnel et qu’aucun consentement n’avait été donné pour leur utilisation ». J’ai toujours un peu de mal avec les gens qui s’insurgent pour les autres (les personnes dénonçant ce plagiat n’étant pas forcément les « sources » utilisées pour créer ces illustrations) mais surtout, même si ça avait été le cas, je trouve que l’argument manque d’honnêteté. Il suffit d’ouvrir un livre d’histoire de l’art pour être obligé d’admettre que c’est tout simplement le principe de fonctionnement de l’art depuis le néolithique, aucun d’entre nous n’a eu à inventer la perspective ou à mélanger ses pigments pour obtenir de la couleur, nous nous sommes appuyés sur les techniques, les innovations, les outils de nos prédécesseurs, mais aussi sur leur style, leur façon particulière de représenter le monde, nous les avons copiés pour apprendre, puis nous les avons fait évoluer dans une direction différente. La copie est le moteur et le principal outil de l’art, rien ne s’est jamais créé dans le vide absolu, personne n’a inventé du jour au lendemain une nouvelle façon de représenter quoi que ce soit sans s’inspirer de ses prédécesseurs. Non, vous avez juste le seum parce que vous avez l’impression que c’est plus « facile ».

Midjourney

S’il est indéniablement plus simple pour quelqu’un qui n’a jamais touché un stylet de produire une illustration potable avec qu’une IA plutôt que de ses mains, produire une image commercialement exploitable est une autre affaire. Au stade actuel (qui risque d’évoluer rapidement), les images générées présentent des défauts assez rédhibitoires, notamment lorsqu’on leur demande par exemple de générer un personnage avec les mains visibles.

Corriger ces détails demandera de passer un temps considérable sur Photoshop ou de relancer la génération un nombre de fois assez conséquent. Maintenant, pour obtenir 13 illustrations qui se ressemblent, avec un style cohérent et des personnages qui se ressemblent d’une page à l’autre, vous en avez pour des dizaines d’heures à torturer les mots-clés de votre prompt (consigne que l’on donne à l’IA) qui va commencer à dangereusement ressembler à un roman, pour essayer de contraindre les générations au maximum, et à re-générer encore et encore les résultats jusqu’à obtenir quelque chose d’exploitable. Dans certains cas, à partir du moment où l’on souhaite faire plus d’une illustration dans le même thème, produire la seconde demandera peut-être autant de temps qu’à un illustrateur chevronné pour la réaliser entièrement ou pour un graphiste à la composer sous Photoshop. Une fois que vous avez la formule, en revanche, les choses s’accélèrent considérablement. Mais trouver cette formule n’est pas aussi aisée que ce l’on pourrait croire (il existe d’ailleurs des IA qui proposent le service inverse : analyser une image pour générer un prompt qui peut possiblement générer quelque chose de similaire). Si sur un coup de chance vous pouvez obtenir le résultat escompté en utilisant des mots humains, il va très certainement vous falloir apprendre le langage de la machine avant de vraiment arriver à vos fins.

Ma première approche a été de copier les tags des autres utilisateurs qui avaient obtenu des résultats proches de ceux que je recherchais. Une énigme cependant m’intriguait : quel que soit mon prompt, j’obtenais une jeune fille de profil sur mon image. Après un processus d’élimination il s’avérait que le responsable était le tag « Lo-fi ». Alors que j’espérais obtenir un effet photographique, cette indication était interprétée par l’IA comme « ajoute-moi la meuf de la chaîne Youtube Lofi Girl ». En effet, l’IA n’ayant pas été programmée (au sens strict du terme), ce sont ses utilisateurs qui lui apprennent quels résultats correspondent à la demande. Ainsi chaque fois que quelqu’un valide un résultat erroné (en réagissant sur la photo ou en demandant une version de meilleure qualité), il renforce l’erreur. Et comme les générations sont publiques sur Discord, ces situations se répètent en permanence (j’ai vu des gens liker ou copier certaines de mes « créations » parce qu’elles étaient jolies alors qu’elles ne correspondaient pas au prompt.) Et j’en arrive aux « vrais » problèmes.

Vers l’infini et au delà

De par la nature opaque du fonctionnement de ces outils, chacun finit par adopter les tags les plus efficaces sans considération pour leur sens, un problème encore exacerbé par la nécessité d’utiliser de nombreux mots-clés en association, ainsi quand on est content du style « Wes Anderson » de notre image sans nous soucier qu’il représente une Batmobile plutôt qu’un Batboat, parce que finalement ça le fait quand même et que comme le disait Paul Valéry « une œuvre a toujours pour origine un accident », on corrompt un peu plus l’outil et contribue à rendre ces tags moins utilisables. Ça posera un problème quand, à force de validations erronées, on sera obligé de taper « chien » pour obtenir un cheval, mais en attendant, ça a déjà très rapidement dérivé vers un appauvrissement et une uniformisation de la création, tout le monde se jette sur les tags qui fonctionnent, lorsque j’ai tenté un « by Taiyo Matsumoto », la moitié du serveur s’est mise à l’utiliser, certains noms d’illustrateurs sont devenus synonymes de « bédé généraliste à l’ancienne », sans que le style soit forcément identifiable à l’auteur tagué. Tout le monde fait des Pikachu, des Batmans, des samouraïs. Au final, toutes ces créations, aussi originales soient-elles prises indépendamment, finissent par se ressembler sur les serveurs de Midjourney. On a un outil qui nous permet d’inventer des choses folles et on fait tous la même chose avec. Depuis cet été ces illustrations ont envahi les forums, les sites de création, bientôt elles débarqueront dans les conventions, dans la pub, sur le Facebook de votre grand-mère. Notre génération qui se noie en permanence dans les mashups, reboots, et autre cross-overs a ici trouvé un outil qui lui permettra d’étaler sa nostalgie ad nauseam sur tous les fronts, un mal peut-être nécessaire qui nous permettra d’atteindre la satiété et l’écœurement jusqu’à enfin proposer quelque chose de nouveau.

Parce qu’en soi, c’est un outil incroyable qui permet rapidement de produire des images d’une qualité folle, et l’espoir que j’entretiens c’est qu’elle nous amène à une nouvelle ère, l’avènement d’un nouvel art nouveau, maximaliste* et généreux, où l’aide de l’IA ne servira pas simplement à gagner du temps ou à copier vite-fait un autre artiste, mais à pousser plus loin la création, à proposer des choses qui n’étaient pas possibles sans un talent, un temps de travail, et un budget conséquents, des choses qu’il n’était pas raisonnable d’explorer avec les contraintes classiques, la démocratisation d’une création audacieuse, libérée et novatrice qui repousse les limites de l’entendement… Enfin en attendant, je retourne faire des Pikachus samouraïs…

(et si vous voulez voir quelques exemples supplémentaires, vous pouvez revoir la partie quiz visuel de notre émission de fin d’année)

(*dans le sens « à l’inverse du minimalisme de ces 15 dernières années, rien à voir avec le Marxisme :p »)

Au même titre que la photographie n’a pas tué la peinture, que Photoshop n’a pas réellement rendu le métier de graphiste plus facile, juste moins pénible et plus accessible, la révolution des IA permet de démocratiser la création et d’offrir à tout le monde la possibilité de donner corps à ses idées, pour le meilleur ou pour le pire, seul l’avenir nous le dira.

PS : J’ai conscience que certaines parties de cet article sont controversées, donc si vous avez des contre-arguments ou des questions je me ferais un plaisir de les lire et d’y répondre en commentaire.

Un mec un peu gauchiste